Table of Contents

Adoção de Assistentes de IA no Desenvolvimento de Software

Menos de dois anos após o lançamento geral do ChatGPT, a maioria dos desenvolvedores de software incorporou assistentes de IA em seus processos de programação. Essa adoção tem impulsionado a eficiência, ao mesmo tempo que tem gerado um aumento na velocidade de desenvolvimento de software, o que torna a manutenção da segurança mais desafiadora.

Aumento nas Downloads de Componentes de Software

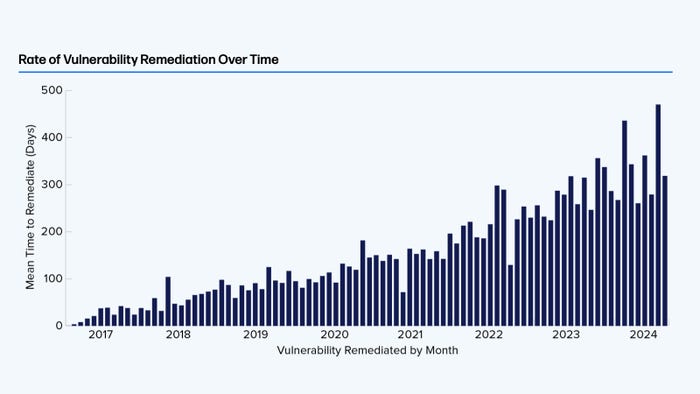

Os desenvolvedores estão a caminho de baixar mais de 6,6 trilhões de componentes de software em 2024, o que inclui um aumento de 70% nos downloads de componentes JavaScript e um aumento de 87% nos módulos Python, de acordo com o relatório anual “State of the Software Supply Chain” da Sonatype. Simultaneamente, o tempo médio para remediar vulnerabilidades nesses projetos de código aberto cresceu significativamente nos últimos sete anos, passando de cerca de 25 dias em 2017 para mais de 300 dias em 2024.

Impacto dos Assistentes de IA na Segurança

Uma das razões prováveis para essa disparidade é que a chegada da IA está acelerando os ciclos de desenvolvimento, dificultando a segurança, segundo Brian Fox, CTO da Sonatype. A maioria dos desenvolvedores agora usa ferramentas de IA em seu processo de desenvolvimento, com 62% dos programadores afirmando que utilizaram um assistente de IA, um aumento em relação aos 44% do ano anterior.

“AI has quickly become a powerful tool for speeding up the coding process, but the pace of security has not progressed as quickly, and it’s creating a gap that is leading to lower-quality, less-secure code.”

Vulnerabilidades Aumentadas

Pesquisadores de segurança alertaram que a geração de código por IA pode resultar em mais vulnerabilidades e ataques novos. Por exemplo, um grupo de pesquisadores demonstrou a capacidade de envenenar modelos de linguagem grande (LLMs) usados para geração de código com código explorável malicioso no Simpósio de Segurança USENIX em agosto. Em março, pesquisadores mostraram que atacantes podiam usar alucinações de IA para direcionar desenvolvedores e suas aplicações a pacotes maliciosos.

Preocupações dos Desenvolvedores

Os desenvolvedores também estão cada vez mais preocupados com a possibilidade de que assistentes de IA sugiram ou propaguem código vulnerável. Embora a maioria dos desenvolvedores (56%) espere que os assistentes de IA forneçam código utilizável, apenas 23% acreditam que o código será seguro, enquanto um grupo maior (40%) não acredita que os assistentes de IA forneçam código seguro, de acordo com uma pesquisa da JetBrains e da Universidade da Califórnia em Irvine, publicada em junho.

Projetos de código aberto demoram mais para remediar vulnerabilidades. Fonte: Sonatype

2024: O Ano do Assistente de IA do Desenvolvedor

Embora os assistentes de IA estejam sendo usados pela maioria dos desenvolvedores, em ambientes empresariais, a adoção de ferramentas de IA é muito mais alta – mais de 90% dos desenvolvedores utilizaram assistentes de IA, segundo a pesquisa Black Duck’s 2024 Global State of DevSecOps. A IA como ferramenta para desenvolvedores está bem consolidada e “nunca vai embora”, afirma Rabon.

Desconfiança em Relação ao Código AI

No entanto, muitos desenvolvedores não possuem a experiência necessária para julgar se o código fornecido por um assistente de IA é seguro. Desenvolvedores iniciantes, por exemplo, são mais confiantes em relação ao código gerado pela IA do que seus colegas mais experientes, com 49% confiando na precisão do código gerado por IA, em comparação com 42% para desenvolvedores mais experientes, de acordo com a pesquisa anual da Stackoverflow.

Impactos na Educação e Carreira dos Desenvolvedores

Além disso, as ferramentas de IA afetarão a educação dos desenvolvedores e poderão dificultar o avanço na carreira para aqueles em início de carreira. A dependência da IA para completar projetos de programação simples pode reduzir a necessidade de novos desenvolvedores que normalmente realizam tarefas de codificação mais simples, eliminando um caminho de treinamento, afirma Fox.

“O desenvolvimento da comunidade está envelhecendo, e a introdução da IA apresenta riscos potenciais para as gerações mais jovens.”

Geração Automática de Código Seguro

Até que as empresas por trás dos assistentes de IA criem datasets de treinamento que contenham sugestões de código seguro, ou implementem guardrails para proteger contra a geração de código vulnerável e malicioso, as empresas precisarão implantar ferramentas automatizadas de segurança de software para verificar o trabalho de qualquer assistente de codificação.

A boa notícia é que, entre as verificações adicionais de segurança e a rápida evolução dos assistentes de geração de código, a segurança de software e aplicações pode eventualmente se tornar muito mais robusta, afirma Rabon.

“Existem certas falhas de segurança básicas que acredito que desaparecerão. Se você pedisse a um sistema de IA para gerar código, por que ele deveria sugerir uma função insegura?”

#InteligenciaArtificial, #DesenvolvimentoDeSoftware, #SegurançaDaInformação, #Programação, #Inovação, #Automação, #IA, #Desenvolvedores